📅 本文时间:2026年4月10日

🎯 目标读者: 技术入门/进阶学习者、在校学生、面试备考者、相关技术栈开发工程师

📚 文章定位: 技术科普 + 原理讲解 + 代码示例 + 面试要点,兼顾易懂性与实用性

开篇引入

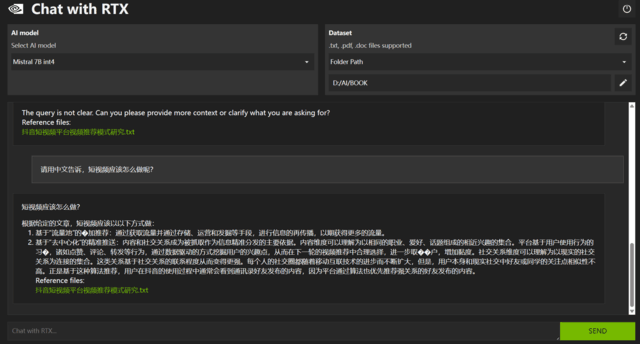

在2026年的游戏开发技术栈中,Unity AI 助手已从一个概念工具演变为开发者日常工作中的核心生产力组件。很多开发者对AI助手的认知停留在“聊聊天就能生成代码”的浅层印象——遇到复杂项目依然卡壳,面试中被问到MCP协议原理时答不上来,甚至混淆Unity官方AI Assistant与第三方MCP Server的区别。本文将从痛点出发,逐步拆解Unity AI助手的技术架构、核心概念、实战代码与底层原理,帮你建立从“会用”到“懂原理”的完整知识链路。

核心关键词: Unity AI 助手、Unity AI Assistant、MCP协议、Model Context Protocol

一、痛点切入:为什么我们需要Unity AI助手?

先来看传统开发的真实困境:

// 传统方式:手动创建并配置一个游戏物体 GameObject player = GameObject.CreatePrimitive(PrimitiveType.Capsule); player.name = "Player"; player.transform.position = new Vector3(0, 1, 0); Rigidbody rb = player.AddComponent<Rigidbody>(); rb.mass = 1.0f; rb.useGravity = true; BoxCollider collider = player.AddComponent<BoxCollider>(); collider.size = new Vector3(1, 2, 1); // 如果需要创建10个类似的物体?写循环。 // 如果需要调整所有物体的位置?手动修改每一处。 // 如果项目规范变了?手动改每一段代码。

传统方式的痛点:

代码冗余:重复性的CRUD操作充斥项目

效率低下:从创意到原型需要大量机械编码

维护困难:批量修改或重构时容易遗漏

学习成本高:新手需要记住海量API的拼写和参数

Unity AI 助手(包括官方Assistant和第三方MCP实现)正是为解决这些问题而生——它不是简单的代码补全工具,而是一个能理解项目上下文、执行编辑操作、生成完整游戏逻辑的智能协同系统-6。

二、核心概念:Unity AI Assistant(官方方案)

2.1 标准定义

Unity AI Assistant 是Unity官方集成在编辑器中的生成式AI工具,帮助开发者探索创意、回答问题、执行项目操作-52。

2.2 关键词拆解

| 关键词 | 含义 |

|---|---|

| 生成式AI | 基于LLM(大型语言模型)生成内容,而非检索现有答案 |

| 编辑器集成 | 原生嵌入Unity Editor,无需外部工具切换 |

| 上下文感知 | 能读取当前项目结构、场景、脚本等信息 |

2.3 生活化类比

想象你有一个专属游戏开发助手:你说“帮我搭个篝火场景”,它立刻摆好地面、放上篝火模型、调整光照——全程不需要你亲自动手。这就是Unity AI Assistant在编辑器里做的事-2。

2.4 三大核心模式

| 模式 | 用途 | 典型指令 |

|---|---|---|

/ask | 回答技术问题、查阅文档 | “什么是协程?” |

/run | 自动执行编辑器操作 | “在原点创建一个立方体” |

/code | 生成C脚本 | “写一个让角色跳跃的脚本” |

Assistant遵循权限控制——修改操作需用户批准,不会擅自改动项目-52。

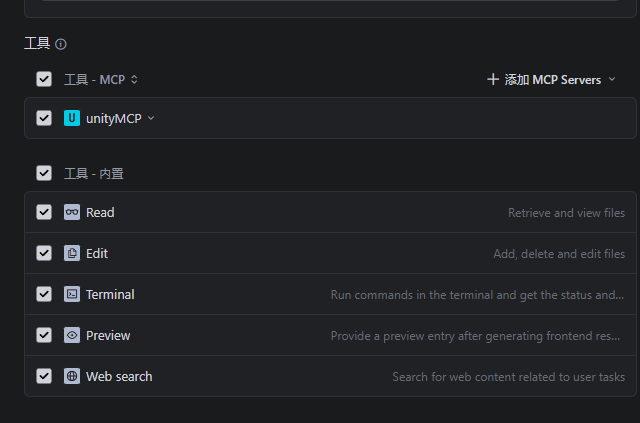

三、关联概念:Unity MCP(Model Context Protocol)

3.1 标准定义

MCP(Model Context Protocol,模型上下文协议) 是一种标准化接口,用于在AI助手和Unity编辑器之间建立双向通信-12。简单理解:如果说Unity AI Assistant是“Unity官方为你配的助手”,那么MCP就是一个通用的“USB接口”——任何支持MCP的AI工具(如Claude、Cursor)都能通过它连接并操作Unity。

3.2 核心关系

| 对比维度 | Unity AI Assistant | Unity MCP Server |

|---|---|---|

| 提供方 | Unity官方 | 开源社区(Coplay、ozankasikci等) |

| 使用位置 | 编辑器内部窗口 | 外部AI客户端 + 编辑器插件 |

| AI模型 | 固定(GPT、Llama) | 可自由选择(Claude、Cursor等) |

| 控制范围 | 通过工具集受限执行 | 可执行任意C API(理论上) |

四、概念关系总结:一张图看懂

┌─────────────────────────────────────────────────────────┐ │ Unity AI 生态系统 │ ├─────────────────────────────────────────────────────────┤ │ │ │ ┌─────────────────┐ ┌─────────────────┐ │ │ │ Unity AI │ │ MCP 生态 │ │ │ │ Assistant │ │(社区驱动) │ │ │ │(官方集成) │ │ │ │ │ ├─────────────────┤ ├─────────────────┤ │ │ │ • 编辑器内使用 │ │ • 外部AI客户端 │ │ │ │ • /ask/run/code │ │ • 可连接Claude │ │ │ │ • 官方LLM │ │ • 任意C API │ │ │ └─────────────────┘ └─────────────────┘ │ │ │ │ 💡 一句话理解:Assistant是“官方配的助手”,MCP是“让任意AI │ │ 都能操作Unity的通用协议”。 │ └─────────────────────────────────────────────────────────┘

五、代码实战:用AI助手创建游戏物体

5.1 传统实现 vs AI助手实现

| 维度 | 传统方式 | AI助手方式 |

|---|---|---|

| 代码量 | ~15行 | 0行(AI生成或直接执行) |

| 修改成本 | 手动改多处 | 一句话重新生成 |

| 学习门槛 | 需记忆API | 自然语言描述即可 |

5.2 实际案例:生成一个简易平台跳跃关卡

向AI助手输入:

“Create a simple platformer level in Unity with a player sphere that has physics, a ground plane, some cube obstacles positioned randomly, a camera at (0, 5, -10) looking at the player, and directional lighting”

AI助手执行后自动生成的C代码(关键部分):

// 自动生成的代码 —— AI理解语义后输出的完整逻辑 using UnityEngine; public class PlatformerSetup : MonoBehaviour { void Start() { // 1. 创建玩家(带物理) GameObject player = GameObject.CreatePrimitive(PrimitiveType.Sphere); player.name = "Player"; player.AddComponent<Rigidbody>(); // 启用重力与物理 player.transform.position = new Vector3(0, 1, 0); // 2. 创建地面 GameObject ground = GameObject.CreatePrimitive(PrimitiveType.Plane); ground.transform.position = new Vector3(0, 0, 0); // 3. 随机生成障碍物(Cube) for (int i = 0; i < 5; i++) { GameObject cube = GameObject.CreatePrimitive(PrimitiveType.Cube); cube.transform.position = new Vector3(Random.Range(-5f, 5f), 0.5f, Random.Range(-5f, 5f)); } // 4. 设置相机视角 Camera.main.transform.position = new Vector3(0, 5, -10); Camera.main.transform.LookAt(player.transform); // 5. 添加方向光 Light directionalLight = FindObjectOfType<Light>(); if (directionalLight == null) { GameObject lightObj = new GameObject("Directional Light"); directionalLight = lightObj.AddComponent<Light>(); directionalLight.type = LightType.Directional; } } }

执行流程解释:

AI解析自然语言指令,提取关键元素(玩家、物理、地面、障碍物、相机、光照)

自动生成完整的C脚本,包含所有对象的创建与配置逻辑

运行时执行脚本,场景即生成完成

参考自Unity-MCP的实际使用案例-。

六、底层原理:技术支撑点

6.1 MCP协议架构

AI Assistant (Claude/Cursor) ↓ MCP协议(标准接口) Unity-MCP STDIO Client ↓ 转发命令 Unity Client (编辑器插件) ↓ 执行C API Unity Editor / Runtime

核心工作流程-12:

AI Assistant:通过MCP协议与Unity-MCP STDIO Client通信

Unity-MCP STDIO Client:将命令转发给Unity Client

Unity Client:在编辑器中执行具体操作并返回结果

AILogger:存储日志和结果供后续查阅

6.2 底层依赖技术

| 技术 | 作用 |

|---|---|

| HTTP/WebSocket | 建立AI客户端与Unity之间的实时通信 |

| C Reflection | AI通过反射调用任意Unity API |

| LLM(GPT/Llama) | 理解自然语言并生成代码 |

| Editor API | Unity提供的编辑器扩展接口 |

6.3 官方AI助理的多层架构

Unity官方AI助理系统采用多层次的模型架构-6:

自然语言处理层:整合OpenAI的GPT系列与Meta的Llama模型,负责代码生成与代理性操作

物件生成与优化层:结合Scenario模型(基于Stable Diffusion、FLUX)与Layer AI模型

上下文整合能力:深度理解开发项目背景,提供比通用AI工具更精准的辅助

七、高阶进阶:Unity ML-Agents

如果Assistant和MCP是“AI帮你写代码”,那么ML-Agents就是“AI自己学会玩游戏”。

ML-Agents(Machine Learning Agents) 是Unity官方的机器学习工具包,让开发者通过强化学习(Reinforcement Learning) 训练智能体执行复杂任务——如自主导航、战斗决策、资源管理等,而非手动编写行为树或状态机-21。

核心概念对比

| 传统游戏AI | ML-Agents AI |

|---|---|

| 开发者写规则 | AI从经验中学习 |

| 行为可预测 | 动态自适应 |

| 维护成本随复杂度指数增长 | 训练完成后自动优化 |

极简示例代码

using Unity.MLAgents; using Unity.MLAgents.Sensors; using Unity.MLAgents.Actuators; public class RollerAgent : Agent { public Transform target; // 目标位置 public float speed = 10f; private Rigidbody rBody; public override void Initialize() { rBody = GetComponent<Rigidbody>(); } // 收集观测数据(AI的“眼睛”) public override void CollectObservations(VectorSensor sensor) { sensor.AddObservation(transform.localPosition); // 自己的位置 sensor.AddObservation(target.localPosition); // 目标的位置 } // 接收动作指令 public override void OnActionReceived(ActionBuffers actionBuffers) { Vector3 move = new Vector3(actionBuffers.ContinuousActions[0], 0, actionBuffers.ContinuousActions[1]); rBody.AddForce(move speed); // 奖励机制:靠近目标得正奖励 float distanceToTarget = Vector3.Distance(transform.localPosition, target.localPosition); if (distanceToTarget < 1.42f) { SetReward(1.0f); // 找到目标,给奖励 EndEpisode(); } // 惩罚机制:掉落则负奖励 if (transform.localPosition.y < 0) { SetReward(-1.0f); EndEpisode(); } } }

工作流程:AI智能体通过尝试-反馈循环,逐步学会从起点滚到目标位置,全程无需编写路径规划逻辑。

八、高频面试题

Q1:请解释Unity AI Assistant的核心功能和架构。

参考答案:

Unity AI Assistant是集成在编辑器中的生成式AI工具,包含Ask(问答)、Run(自动操作)、Code(代码生成) 三大模式

底层整合OpenAI GPT系列和Meta Llama模型

采用多层次架构:自然语言处理层 + 物件生成与优化层 + 上下文整合层-6

踩分点:能答出三种模式 + 底层LLM + 项目上下文感知

Q2:MCP协议是什么?它与Unity AI Assistant有何区别?

参考答案:

MCP(Model Context Protocol,模型上下文协议) 是一种标准化接口,让AI助手与Unity编辑器之间建立双向通信

区别:Assistant是Unity官方集成方案,开箱即用;MCP Server是社区开源方案,允许任意MCP兼容的AI客户端连接Unity

记忆口诀:“官方给助手,协议给连接”

Q3:ML-Agents与传统行为树/FSM相比有何优势?

参考答案:

ML-Agents使用强化学习,AI从经验中学习最优策略,而非手动编写规则

能够发现人类设计师可能忽视的策略,动态适应玩家行为

核心组件:Agent、Behavior Parameters、Reward System

关键区分:传统方式写“规则”,ML-Agents写“奖励函数”

Q4:如何保证AI生成的Unity代码质量?

参考答案:

使用上下文感知工具(如Assistant的Attach功能),让AI理解项目现状

分步构建:复杂任务拆解为多个子指令-54

人工审查:AI生成的代码需经过Code Review

版本控制:AI操作应有明确的撤销/回滚机制

踩分点:能答出上下文感知 + 分步构建 + 人工审查流程

九、结尾总结

核心知识点回顾

| 知识点 | 一句话总结 |

|---|---|

| Unity AI Assistant | 编辑器内集成,Ask/Run/Code三大模式 |

| MCP协议 | 让AI连接Unity的标准化“接口” |

| ML-Agents | 强化学习训练自适应AI,替代手工行为树 |

| 底层技术 | HTTP/WebSocket + C Reflection + LLM |

重点与易错点

✅ AI助手是辅助工具,不能完全替代开发者的架构设计能力

✅ MCP Server能执行任意C API,需注意权限控制和安全边界

❌ 不要把AI生成的代码直接用于生产,务必审查与测试

❌ 不混淆Assistant(官方工具)与MCP(协议标准)

下篇预告

本文带你入门Unity AI助手的核心概念与实战。下一篇我们将深入MCP Server的自定义开发,手把手教你写一个Unity编辑器插件,让AI能调用的工具由你自己定义。

📌 本文时间:2026年4月10日

💡 互动问题:你在实际项目中用过Unity AI助手吗?遇到过哪些翻车情况?欢迎在评论区分享,我会选出典型案例在下篇文章中分析。

参考来源:Unity官方文档、Unity 6.2 CG Channel报道、Unity-MCP开源项目、Unity ML-Agents技术博客等。

扫一扫微信交流

扫一扫微信交流